Drie krachten zijn recent samengekomen en hebben een noodzaak gecreëerd om AI toe te passen binnen IoT-toepassingen:

- De hoeveelheid én gevoeligheid van IoT-data zijn sterk toegenomen.

- LLM’s (Large Language Models) bieden krachtige patroonherkenning en ondersteunende tools die helpen deze data te begrijpen.

- Als gevolg hiervan is regelgeving ontstaan om controle te bieden en het publiek te beschermen: de EU AI Act staat naast de GDPR, en voegt documentatie-, toezicht- en risicoclassificatie-verplichtingen toe voor bepaalde IoT-toepassingen.

Het doel van deze kaders is om innovatie mogelijk te maken, maar met duidelijke verantwoordelijkheid.

Dit artikel vat daarom de belangrijkste aandachtspunten samen voor het inzetten van LLM’s met IoT-data, zonder juridische of vertrouwensproblemen te veroorzaken.

Waarom dit belangrijk is

Uw verbonden apparaten (meters, sensoren, camera’s, wearables, voertuigen, enz.) genereren data die kosten kunnen besparen, de veiligheid verhogen en processen versnellen.

Large Language Models (LLM’s), geavanceerde AI-systemen die tekst kunnen lezen en schrijven, kunnen deze verzamelde data omzetten in duidelijke samenvattingen, aanbevelingen en actielijsten.

De potentiële voordelen zijn dus enorm, maar de risico’s zijn dat ook: vooral wanneer persoonlijke data verkeerd worden behandeld of wanneer beslissingen worden genomen zonder menselijke controle.

In deze context verplicht de Europese regelgeving, GDPR (voor privacy) en de AI Act (voor AI-veiligheid), organisaties om controle te houden over:

- wie wat mag zien,

- met welk doel,

- voor welke periode,

- en om dit te kunnen bewijzen.

De basisprincipes

De kern van succes ligt in eenvoudige en transparante processen. Bijvoorbeeld:

- Verzamel zo weinig mogelijk. Registreer alleen wat de dienst echt nodig heeft.

- Verwijder gevoelige informatie zo vroeg mogelijk. Haal namen, gezichten of exacte locaties eruit voordat data het terrein of gateway verlaat.

- Bewaar brondata in EU-gebaseerde, door het bedrijf beheerde opslag. Gebruik korte bewaartermijnen, sterke toegangscontrole en private verbindingen.

- Laat de AI informatie opvragen tijdens uitvoering in plaats van te leren uit alles. Wanneer het model antwoordt, haalt het alleen de goedgekeurde documenten op die nodig zijn — het wordt niet getraind op de volledige geschiedenis.

- Behoud menselijke controle over beslissingen die mensen kunnen raken (gezondheid, werk, uitkeringen, rechten). Menselijke beoordeling blijft verplicht.

Documenteer alles. Noteer wat u doet, waarom, waar data zich bevindt en hoe lang die wordt bewaard. Bewijs telt meer dan beloften.

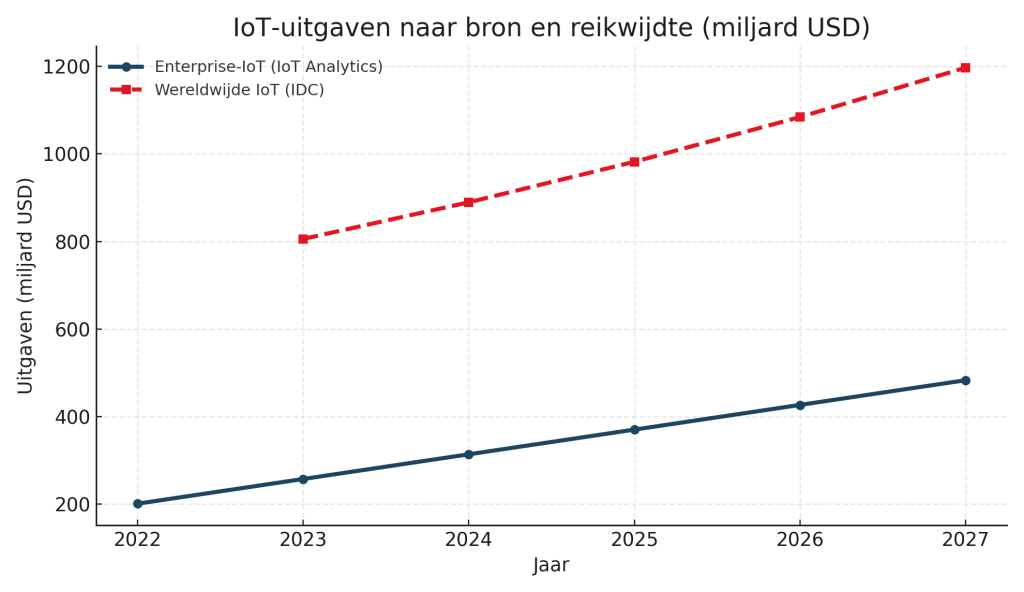

De groei en samensmelting van IoT en AI

De wereldwijde investeringen in IoT blijven toenemen, van ongeveer $201 miljard in 2022 naar een geschatte $483 miljard in 2027 (IoT Analytics, 2023). Wereldwijd (inclusief consumententoepassingen) zal de IoT-markt volgens IDC in 2026 de grens van $1 biljoen overschrijden, met een gemiddelde jaarlijkse groei van ongeveer 10,4% tussen 2023 en 2027.

Kort gezegd: er is zowel geld als momentum in de technologische keten die apparaten, netwerken, dataplatforms en nu ook AI met elkaar verbindt.

Figuur 1 — Onderzochte en voorspelde IoT-uitgaven per bron en omvang (miljarden USD, 2022–2027)

- Enterprise IoT (IoT Analytics) vs. Worldwide IoT (IDC). Endpoints from IoT Analytics — $201B (2022) and $483B (2027): https://iot-analytics.com/how-enterprise-iot-market-is-evolving/ (PDF: https://iot-analytics.com/wp-content/uploads/2023/06/Insights-Release-Winning-in-IoT-How-the-enterprise-IoT-market-is-evolving.pdf).

- IDC worldwide IoT spend — $805.7B (2023), surpassing $1T in 2026, CAGR 10.4% (2023–2027): https://www.businesswire.com/news/home/20230620731001/en/Worldwide-Spending-on-the-Internet-of-Things-is-Forecast-to-Surpass-%241-Trillion-in-2026-According-to-a-New-IDC-Spending-Guide. Intervening years are CSL interpolations for presentation.

De commerciële kans

De commerciële deur staat nu open om IoT-datasets te combineren met AI-systemen. Maar organisaties moeten daarbij wél aan de juiste kant van de regelgeving blijven.

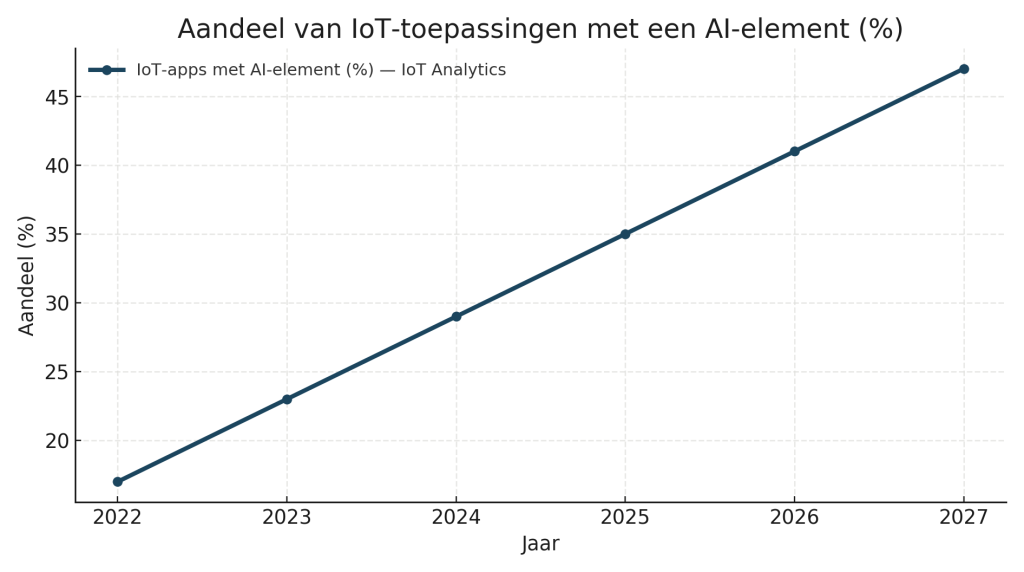

De adoptie van AI binnen IoT verschuift inmiddels van pilotprojecten naar een standaardonderdeel van operationele systemen.

Zo voorspelt onderzoek van IoT Analytics dat het aandeel industriële IoT-toepassingen met een AI-component stijgt van ongeveer 17% in 2022 naar 47% in 2027.

Dat betekent dat het gemiddelde IoT-programma van uw concurrent binnen de komende twee jaar waarschijnlijk al AI-ondersteunde functies zal bevatten, zoals geautomatiseerde analyses, samenvattingen, voorspellingen of beleidscontrolemechanismen.

Niets doen vergroot dus het risico op een groeiende prestatiekloof op het gebied van veiligheid, uptime en operationele efficiëntie.

Figuur 2 — Aandeel IoT-toepassingen met een AI-element (%) (2022–2027)

- IoT Analytics endpoints: ~17% in 2022 (6% AI-based + 11% AI-augmented) and ~47% in 2027. Source page: https://iot-analytics.com/how-enterprise-iot-market-is-evolving/ (PDF: https://iot-analytics.com/wp-content/uploads/2023/06/Insights-Release-Winning-in-IoT-How-the-enterprise-IoT-market-is-evolving.pdf). Intervening years are CSL interpolations for presentation: Accessed: 07 October 2025 (Europe/UK).

De belangrijkste les

Hoewel het onderzoek vooral de macrotrend toont, is de boodschap duidelijk: met de juiste IoT- en AI-architectuur, implementatie en KPI’s kunnen organisaties deze rekenkracht omzetten in zichtbare voordelen en meetbare bedrijfswaarde.

De essentie:

- De markt groeit snel.

- Concurrenten verweven AI in de kern van hun systemen.

- En de regelgevende kaders zijn inmiddels duidelijk afgebakend.

Regelgevende duidelijkheid

Regelgevende duidelijkheid is cruciaal om uitvoeringsrisico’s te verkleinen, maar vereist ook dat je vanaf het begin de juiste architectuur en principes kiest.

De EU AI Act en de GDPR bieden organisaties nu voorspelbare richtlijnen met:

- een wettelijke basis en reikwijdte voor dataminimalisatie aan de edge;

- het belang van menselijke tussenkomst bij beslissingen met impact;

- het vermijden van verboden praktijken (zoals biometrische categorisering of emotiedetectie);

- en een duidelijke aanpak voor datatransfers via:

- Standard Contractual Clauses (SCC’s) met een Transfer Impact Assessment (TIA) conform Schrems II (C-311/18); of

- het EU-VS Data Privacy Framework (DPF), mits er een actieve certificering is.

Meer informatie:

- Overzicht AI Act / GDPR → https://eur-lex.europa.eu

- SCC’s → https://eur-lex.europa.eu/eli/dec_impl/2021/914/oj

- DPF-register → https://www.dataprivacyframework.gov/s/participants

AI en IoT – juridisch, in eenvoudige taal

- GDPR (privacy):

Je moet een duidelijke rechtsgrond hebben om persoonsgegevens te gebruiken (“lawful basis”). Informeer betrokkenen, bewaar data slechts zolang als nodig en bescherm ze adequaat. Voor gevoelige data (zoals gezondheid of biometrie) gelden strengere eisen. - AI Act (veiligheid):

Wanneer AI helpt bij belangrijke beslissingen (zoals in de zorg of kritieke infrastructuur), zijn extra controles verplicht: menselijke supervisie, kwaliteitscontroles en doorlopend toezicht. - Internationale overdrachten:

Als gegevens de EU verlaten, zijn standaard-juridische waarborgen verplicht plus een beoordeling van de veiligheid en rechtmatigheid van die overdracht.

Een verdedigbare architectuur

Wie AI in IoT-toepassingen wil integreren, moet werken vanuit een verdedigbare architectuur, één die naleving en vertrouwen borgt.

Belangrijke uitgangspunten:

- Edge-first: filter en anonimiseer zoveel mogelijk data vóór verzending.

- Eigen bibliotheek: sla documenten en logs op binnen EU-gebaseerde systemen onder eigen controle; de AI haalt daar alleen relevante stukken op.

- Goedgekeurde opslag: opslag in de EU, alleen via private verbindingen, versleuteld met je eigen sleutels, en voorzien van geautomatiseerde verwijderingsschema’s.

- Geen training op jouw data – tenzij expliciet toegestaan: AI mag je materiaal gebruiken voor antwoorden, maar niet leren uit jouw data zonder een duidelijke rechtsgrond.

- Retrieval-Augmented Generation (RAG): hierbij haalt het model context op tijdens de uitvoering uit jouw goedgekeurde databronnen (documenten, logs, vectoren enz.).

De AI raadt niet uit geheugen, maar antwoordt op basis van gecontroleerde context.

Een edge-first, sessiegeïsoleerde RAG-architectuur bovenop goedgekeurde opslag helpt aan veel wettelijke plichten te voldoen, én levert direct operationele voordelen.

Praktische voordelen in de operatie

Van telezorg tot nutsbedrijven, wagenparken en kritieke infrastructuren: hetzelfde patroon, vroegtijdige dataminimalisatie, gecontroleerde retrieval, aantoonbare supervisie.

Leidt tot:

- snellere incidentafhandeling,

- minder foutmeldingen,

- veiliger interventies,

- en lagere cloud- en opslagkosten.

Hoe goed eruitziet in veelvoorkomende scenario’s

Zorg & telezorg

AI kan helpen bij het opstellen van samenvattingen en het signaleren van risico’s, maar een arts of getrainde hulpverlener moet de output goedkeuren. Gevoelige details moeten vroegtijdig worden geanonimiseerd, bijvoorbeeld door ruwe audio of video slechts kort te bewaren en vervolgens te verwijderen.

Elke melding of waarschuwing moet een controlepad bevatten dat toont wie deze heeft beoordeeld en waarom.

Energie & nutsvoorzieningen

AI kan afwijkingen detecteren en deze in duidelijke taal toelichten. In zulke omgevingen worden meterstanden geaggregeerd, locatieprecisie beperkt en retentietermijnen kort gehouden: doorgaans maanden, geen jaren.

Beheerde connectiviteit (SIM’s en netwerken)

AI-analyses moeten pseudoniemen gebruiken in plaats van echte identiteiten. Exacte apparaatlocaties worden vervaagd, tenzij strikt noodzakelijk.

Klanten moeten transparante meldingen krijgen over welke gegevens worden verzameld en met welk doel.

EV-laadinfrastructuur

Beveiliging van de verbinding is cruciaal. Sessies worden samengevat voor operationele en facturatiedoeleinden. Eventuele videobeelden voor claims worden standaard gemaskeerd en snel verwijderd na afhandeling van het dossier.

Voertuigtelemetrie & dashcams

AI-inzichten kunnen bijdragen aan veiligere rijstijlen en vlootbeheer, maar elke beslissing die invloed heeft op iemands werk of beoordeling vereist menselijke goedkeuring. Gezichten en kentekens in videobeelden moeten worden geblurd, tenzij de wet anders voorschrijft.

CCTV & beveiliging

Wanneer cameratoezicht bedoeld is voor terreinbeveiliging, moeten duidelijke waarschuwingsborden aanwezig zijn. Toegang tot beelden moet beperkt zijn,

en bezettingsanalyses moeten geaggregeerd worden om individuele tracking te voorkomen.

Vijf leiderschapsbeslissingen die het verschil maken

- Stel duidelijke doelgrenzen. Keur elk gebruiksdoel afzonderlijk goed met een naam en afgebakende scope (bv. “alarmtriage”, “claimsrapportage”).

Vermijd vage mandaten zoals “gebruik overal in het bedrijf”. - Beheer datalokatie en toegang. Eis EU-gebaseerde opslag, private connectiviteit, eigen encryptiesleutels en verwijderingsschema’s.

Vraag bewijs van implementatie. - Zorg voor menselijke supervisie. Definieer welke beslissingen door mensen moeten worden goedgekeurd voordat ze worden uitgevoerd.

Meet en rapporteer of dat ook daadwerkelijk gebeurt. - Beperk leveranciers en voorwaarden. Leg logbeleid, regio’s, subprocessors en auditrechten contractueel vast. Standaardinstelling: “geen training op onze data”.

- Bouw een ‘bewijscultuur’. Maak van “toon me het bewijs” een reflex. Houd bij wat werd geopend, door wie, met welk doel, en wanneer het werd verwijderd.

Handige tips

- Ontwerparchitectuur: Maak éénpagina-diagrammen die tonen waar data wordt geanonimiseerd, opgeslagen en hoe AI-context ophaalt.

- Procescontroles: Weet welke beslissingen menselijke goedkeuring vereisen, en volg hoe vaak dat fout gaat of vertraagd is.

- Data: Bepaal wat je bewaart, hoe lang, en wie toegang heeft. Zorg dat verwijderingslogs regelmatig worden gecontroleerd.

- Goedgekeurde leveranciers: Handhaaf EU-locaties, private verbindingen en eigen encryptiesleutels. Minimaliseer logging voor gegevensbescherming.

- Wet & risico:

- Breek applicaties op in duidelijk gedefinieerde use cases.

- Zorg dat de juridische grondslag voor elk geval gedocumenteerd is.

- Weet waar buiten-EU-overdrachten plaatsvinden en welke waarborgen gelden.

- Indien een toepassing als hoog risico wordt beschouwd onder de AI Act, documenteer dan extra maatregelen die zijn genomen om te voldoen aan AI Act en GDPR

KPI’s en maandelijkse controles

- Veiligheid & nauwkeurigheid: Aantal valse alarmen, gemiste gebeurtenissen, tijd tot menselijke review en correctie.

- Privacyhygiëne: Percentage tijdig verwijderde data, aantal toegangsafwijkingen, frequentie van minimale retrieval.

- Vertrouwen: Tijd tot afhandeling van inzage-/verwijderingsverzoeken, incidentaantallen, klachten en trends.

- Leveranciers: Gebruik van ongeautoriseerde regio’s of logging, en tijd tot blokkeren van verkeerd geconfigureerde endpoints.

Rode lijnen (niet overschrijden)

- Geen emotiedetectie of persoonsclassificatie via gezichten of stemmen in werk- of openbare ruimtes.

- Vermijd volledig geautomatiseerde beslissingen met juridische of vergelijkbare gevolgen (GDPR Art. 22). Als een uitzondering wordt toegepast, implementeer menselijke herziening en veiligheidsmaatregelen.

- Kopieer geen ruwe persoonsgegevens in AI-trainingssets zonder een nieuwe juridische toets en bijgewerkte kennisgevingen.

Een eenvoudig 30-60-90-dagenplan om AI in IoT-toepassingen te begrijpen

Eerste 30 dagen

- Kies één prioritaire use case.

- Breng het doel, de datastroom en de menselijke toezichtsmomenten in kaart.

- Controleer leverancierscontracten op regio’s, sleutels en logging.

- Vereis EU-opslag met private verbindingen voor al je AI-integraties.

- Stel verwijderingsschema’s in voor prompts, outputs en logs, en bewijs dat ze werken.

- Zet standaardvervaging aan voor gezichten en kentekens in elke video.

- Voeg een éénpagina-goedkeuringsformulier toe om menselijke supervisie te ondersteunen.

Dag 31–60

- Voer een korte privacy-impactbeoordeling (PIA) uit.

- Voeg monitoring toe voor valse alarmen en gemiste gebeurtenissen.

- Start met maandelijkse KPI-metingen.

- Train medewerkers in de nieuwe toezichtprocessen.

Dag 61–90

- Brei de aanpak uit naar de tweede en derde use case met dezelfde werkwijze.

- Publiceer een korte kennisgeving getiteld “Hoe wij AI gebruiken met apparaten” voor klanten en personeel.

De bottom line voor leiders en besluitvormers

Je hoeft geen technisch expert te zijn om goede beslissingen te nemen bij het integreren van AI in IoT-systemen.

Wat wél essentieel is, is inzicht in de kernprincipes voor veilige, wettige en effectieve implementatie:

- Eenvoud en transparantie in architectuur en processen.

- Dataminimalisatie en Europese opslag als standaard.

- Menselijke supervisie waar beslissingen gevolgen hebben.

- Bewijsvoering en audittrail als dagelijkse praktijk.

Door deze basis te volgen, kunnen organisaties de voordelen van AI benutten — snellere reacties, lagere kosten, betere veiligheid — zonder de regels van de EU (GDPR en AI Act) te overtreden.

Als je meer wilt weten over hoe je AI op een veilige en verantwoorde manier kunt implementeren binnen je data-architecturen, neem dan contact op met CSL voor meer informatie.

Referenties en citaten

- [A1] Regulation (EU) 2024/1689 — EU AI Act – Official Journal text laying down harmonised rules on artificial intelligence, including Article 53 (obligations for providers of general-purpose AI models); it sets human oversight and high-risk duties across Chapter III. Link: https://eur-lex.europa.eu/eli/reg/2024/1689/oj/eng

- [A2] Regulation (EU) 2016/679 — GDPR – General Data Protection Regulation covering data processing principles (Art. 5), lawful bases (Art. 6), and special categories of personal data (Art. 9). Link: https://eur-lex.europa.eu/legal-content/EN/TXT/?uri=CELEX:32016R0679

- [D1] Commission Implementing Decision (EU) 2023/1795 – Adequacy decision for the EU-US Data Privacy Framework (DPF) under the GDPR. Link: https://eur-lex.europa.eu/eli/dec_impl/2023/1795/oj

- [E1] EDPB Guidelines 05/2020 on consent – European Data Protection Board guidance clarifying how to obtain and withdraw valid consent under the GDPR. Link: https://edpb.europa.eu/our-work-tools/our-documents/guidelines/guidelines-052020-consent-under-regulation-2016679-0_en

- [E2] EDPB Guidelines 07/2020 on controller/processor concepts – Guidance on roles and responsibilities of controllers and processors under the GDPR. Link: https://edpb.europa.eu/our-work-tools/our-documents/guidelines/guidelines-072020-concepts-controller-and-processor-gdpr_en

- [E3] EDPB Guidelines 4/2019 on Article 25 – Guidance on data protection by design and by default. Link: https://edpb.europa.eu/our-work-tools/our-documents/guidelines/guidelines-42019-article-25-data-protection-design-and-default_en

- [E4] EDPB Guidelines 05/2021 on Art. 3 & Chapter V (transfers) – Guidance on when processing constitutes a transfer of personal data and how Chapter V applies. Link: https://edpb.europa.eu/our-work-tools/our-documents/guidelines/guidelines-052021-interplay-betweenthe-application-gdpr_en

- [E5] Directive 2002/58/EC — ePrivacy Directive – Current EU framework governing communications metadata and location data; the proposed ePrivacy Regulation is still not in force. Link: https://eur-lex.europa.eu/legal-content/EN/TXT/?uri=CELEX:32002L0058

- [J1] CJEU C311/18 (“Schrems II”) – Court of Justice decision laying out requirements for transfer impact assessments (TIAs) and safeguards for third country transfers under the GDPR. Link: https://eur-lex.europa.eu/legal-content/EN/TXT/?uri=CELEX:62018CJ0311

- [W1] WP29 Opinion 04/2013 (WP205) on the DPIA Template for Smart Grid & Smart Metering Systems – Opinion on DPIA expectations for smart energy systems. Link: https://ec.europa.eu/justice/article-29/documentation/opinion-recommendation/files/2013/wp205_en.pdf

- [W2] WP29 Opinion 12/2011 (WP183) on Smart Metering – Opinion covering privacy risks of consumption pattern data and mitigation measures. Link: https://ec.europa.eu/justice/article-29/documentation/opinion-recommendation/files/2011/wp183_en.pdf

- [W3] WP29 Guidelines on Automated Individual Decision making and Profiling (WP251 rev.01) – Guidance on safeguards and Article 22 interpretation concerning automated decisions and profiling. Link: https://ec.europa.eu/newsroom/article29/items/612053

Primary references for connectivity & controls:

- ETSI EN 303 645 – Consumer IoT security baseline: unique credentials, secure updates, cryptography, and vulnerability handling. Link: https://www.etsi.org/technologies/consumer-iot-security

- ENISA IoT guidance – Baseline and supply chain guidance for securing IoT devices. Link: https://www.enisa.europa.eu/publications/good-practices-for-security-of-iot

- RFC 8995 (BRSKI) – Automated onboarding protocol for issuing device certificates. Link: https://www.rfc-editor.org/rfc/rfc8995

- RFC 7030 (EST) – Enrolment over Secure Transport protocol for certificate management. Link: https://www.rfc-editor.org/rfc/rfc7030

- RFC 8520 (MUD) – Manufacturer Usage Description for device network profiles. Link: https://www.rfc-editor.org/rfc/rfc8520

- TLS 1.2 / TLS 1.3 – Transport Layer Security specifications. Links: https://www.rfc-editor.org/rfc/rfc5246 (TLS 1.2) and https://www.rfc-editor.org/rfc/rfc8446 (TLS 1.3)

- DTLS 1.2 – Datagram TLS specification. Link: https://www.rfc-editor.org/rfc/rfc6347

- OCPP 2.0.1 Security – Security specification for the Open Charge Point Protocol used in EV charging networks. Link: https://www.openchargealliance.org/protocols/ocpp-201/

- NIS2 – Directive on the security of network and information systems. Link: https://eur-lex.europa.eu/eli/dir/2022/2555/oj

- Cyber Resilience Act (CRA) – Proposal to strengthen cybersecurity for products with digital elements. Link: https://digital-strategy.ec.europa.eu/en/policies/cyber-resilience-act

- ePrivacy Directive – See [E5]

- SCC – Standard Contractual Clauses for cross border data transfers. Link: https://eur-lex.europa.eu/eli/dec_impl/2021/914/oj

- EU‑US DPF – List of U.S. organisations certified under the Data Privacy Framework. Link: https://www.dataprivacyframework.gov/s/participants

- Schrems II – See [J1]