Recientemente han convergido tres fuerzas que han creado la necesidad imperiosa de utilizar la IA en aplicaciones de IoT:

(1) Ha aumentado el volumen de datos del IoT y su sensibilidad.

(2) Los LLM ofrecen potentes herramientas de búsqueda de patrones y apoyo que ayudan a dar sentido a estos datos.

Como resultado, se han creado regulaciones para proporcionar controles y proteger al público.

(3) La Ley de IA de la UE se suma al RGPD, añadiendo obligaciones de documentación, supervisión y clasificación de riesgos para algunas implementaciones de IoT.

El resultado deseado es permitir las oportunidades, pero con una responsabilidad clara.

Por lo tanto, este artículo resume algunas de las cuestiones clave a la hora de implementar LLM con datos del IoT sin incurrir en problemas legales o de confianza.

Por qué es importante

Sus diversos dispositivos conectados (contadores, sensores, cámaras, dispositivos wearables, vehículos) generan datos que pueden ahorrar dinero, mejorar la seguridad y agilizar los servicios.

Los modelos de lenguaje de gran tamaño (LLM), una IA avanzada que lee y escribe texto, pueden convertir esos datos recopilados y conectados en resúmenes claros, recomendaciones y listas de acciones.

Por lo tanto, las ventajas potenciales son grandes, pero también lo son los riesgos si se gestionan mal los datos personales o si se toman decisiones sin supervisión humana.

En estos contextos, las normas europeas (el RGPD [A2] para la privacidad y la Ley de IA [A1] para la seguridad de la IA) esperan que controles:

- quién ve qué,

- con qué finalidad,

- durante cuánto tiempo,

- y que pueda demostrarlo.

Los principios básicos

La receta fundamental para el éxito es mantener la sencillez. Por ejemplo:

- Recopila lo menos posible. Captura solo lo que el servicio necesita.

- Elimina los datos confidenciales desde el principio. Elimina nombres, rostros o ubicaciones exactas cerca del dispositivo o la puerta de enlace antes de que nada salga del sitio.

- Mantén el material original en un almacenamiento controlado por la empresa y ubicado en la UE. Utiliza una retención breve, controles de acceso estrictos y conexiones privadas.

- Deja que el elemento de IA busque la información en tiempo real en lugar de aprender de todo. Cuando el modelo de IA responda a una pregunta, debes recuperar solo los pocos documentos seleccionados y aprobados que necesitas de tu almacén, no estar entrenado con todo tu historial.

- Mantén siempre a una persona a cargo de todo lo que afecte a las personas. Si una acción puede afectar a la salud, el empleo, las prestaciones o los derechos legales, exige una revisión humana.

- Documenta lo que haces, por qué lo haces, dónde se encuentran los datos y cuánto tiempo los conservas. Las pruebas prevalecen sobre las garantías.

El crecimiento y la convergencia del IoT y la IA

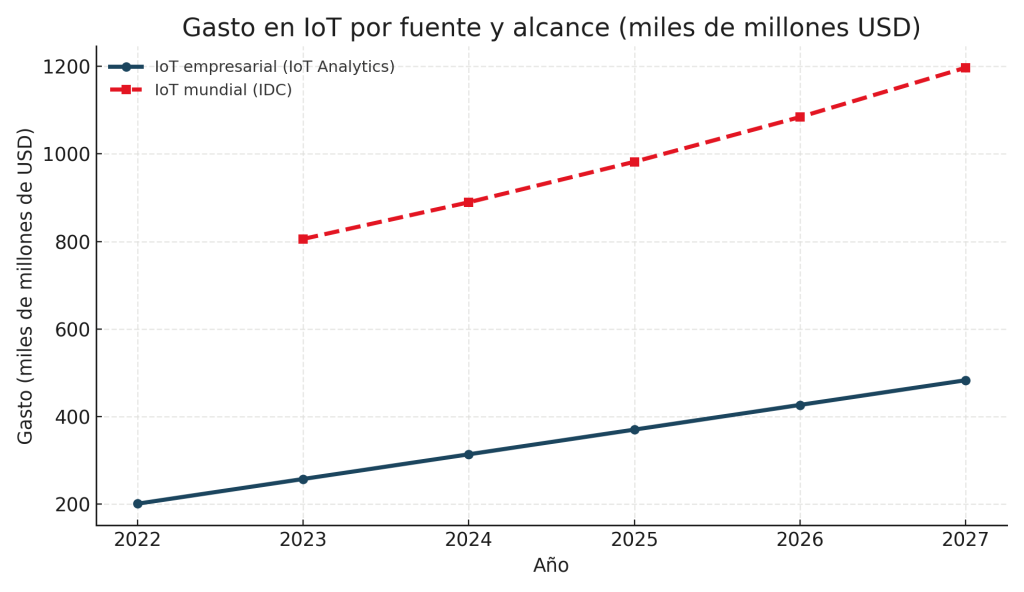

En general, los presupuestos de IoT de las empresas siguen aumentando, pasando de unos 201 000 millones de dólares en 2022 a una previsión de 483 000 millones en 2027 (IoT Analytics, 2023), y se prevé que el gasto mundial en IoT (incluido el de los consumidores) supere el billón de dólares en 2026, con una tasa de crecimiento anual compuesta de alrededor del 10,4 % (IDC, 2025). En resumen: hay dinero e impulso en la pila tecnológica que conecta dispositivos, redes, plataformas de datos y ahora la IA.

Figura 1: Gasto en IoT investigado y previsto por fuente y alcance (miles de millones de dólares, 2022-2027)

- IoT empresarial (IoT Analytics) frente a IoT mundial (IDC). Puntos finales de IoT Analytics: 201 000 millones de dólares (2022) y 483 000 millones de dólares (2027): https://iot-analytics.com/how-enterprise-iot-market-is-evolving/ (PDF: https://iot-analytics.com/wp-content/uploads/2023/06/Insights-Release-Winning-in-IoT-How-the-enterprise-IoT-market-is-evolving.pdf).

- Gasto mundial en IoT según IDC: 805 700 millones de dólares (2023), superando el billón de dólares en 2026, con una tasa compuesta de crecimiento anual del 10,4 % (2023-2027): https://www.businesswire.com/news/home/20230620731001/en/Worldwide-Spending-on-the-Internet-of-Things-is-Forecast-to-Surpass-%241-Trillion-in-2026-According-to-a-New-IDC-Spending-Guide. Los años intermedios son interpolaciones de CSL para la presentación.

La ventana comercial también está abierta ahora para combinar conjuntos de datos del IoT con sistemas de IA, pero es fundamental que las organizaciones se mantengan dentro de la legalidad.

La adopción de la IA y el IoT está empezando a pasar de ser una prueba piloto a convertirse en una capacidad predeterminada.

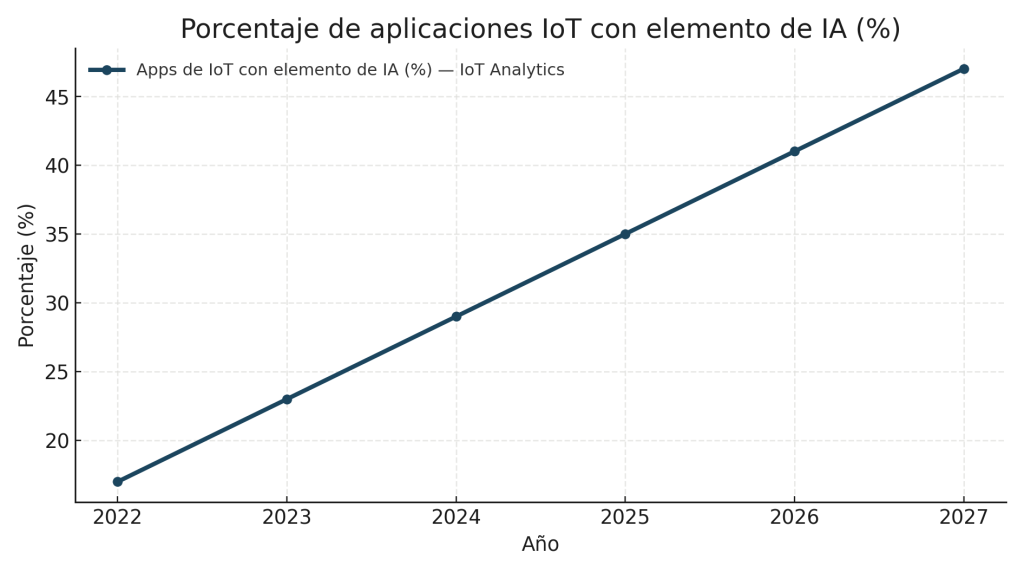

Por ejemplo, la investigación de IoT Analytics sobre el IoT industrial muestra que las aplicaciones con un elemento de IA prevén un aumento del ~17 % en 2022 al ~47 % en 2027.

Esto significa que el programa medio de IoT con el que compite probablemente comenzará a ofrecer una combinación de medidas de clasificación, resumen, previsión o aplicación de políticas asistidas por IA en los próximos dos años.

Por lo tanto, quedarse estancado ahora crea la posibilidad de que se amplíe la brecha de rendimiento en materia de seguridad, tiempo de actividad y economía operativa.

Figura 2: Porcentaje de aplicaciones de IoT con un elemento de IA (%) (2022-2027)

- Puntos finales de IoT Analytics: ~17 % en 2022 (6 % basados en IA + 11 % aumentados con IA) y ~47 % en 2027. Página de origen: https://iot-analytics.com/how-enterprise-iot-market-is-evolving/ (PDF: https://iot-analytics.com/wp-content/uploads/2023/06/Insights-Release-Winning-in-IoT-How-the-enterprise-IoT-market-is-evolving.pdf). Los años intermedios son interpolaciones de CSL para la presentación: Consultado: 7 de octubre de 2025 (Europa/Reino Unido).

Aunque la investigación solo muestra la tendencia macro, ilustra que su matriz de diseño e implementación de IoT e IA (y los KPI) pueden, si se utilizan con prudencia y diligencia, convertir esa potencia informática en beneficios locales y valor empresarial general.

La conclusión es que el mercado está creciendo, los competidores están incorporando la IA en la estructura de sus sistemas y el camino hacia el cumplimiento normativo está ahora bien trazado.

Claridad normativa

La claridad normativa es clave para ayudar a reducir el riesgo de ejecución en este entorno, pero también depende de que seleccione la arquitectura y los principios adecuados desde el principio.

La Ley de IA de la UE y el RGPD proporcionan ahora a los implementadores unas barreras de protección predecibles:

- base legal y alcance para la minimización en el extremo;

- especificar la importancia de la intervención humana para obtener resultados impactantes;

- evitar prácticas prohibidas (por ejemplo, categorización biométrica/detección de emociones),

- y un enfoque de transferencia limpio en términos de:

- Cláusulas contractuales tipo (SCC) con una evaluación del impacto de la transferencia (TIA) en virtud de Schrems II (C-311/18), o a través del Marco de Protección de Datos UE-EE. (DPF), cuando proceda, tras confirmar la certificación activa.

Para obtener más información, consulta:

- (Resumen de la Ley de IA/RGPD: https://eur-lex.europa.eu/

- SCC: https://eur-lex.europa.eu/eli/dec_impl/2021/914/oj

- DPF: https://www.dataprivacyframework.gov/s/participants)

IA e IoT: en términos legales y sencillos

- RGPD (privacidad): debes tener una razón clara para utilizar datos personales (la «base legal»), por lo que deberás informar a las personas sobre su uso y conservarlos solo durante el tiempo necesario, además de protegerlos. Si los datos son sensibles (salud, datos biométricos), el listón es más alto.

- Ley de IA (seguridad de la IA): si el componente de IA ayuda a tomar decisiones importantes (por ejemplo, en el ámbito de la sanidad o las infraestructuras críticas), debes añadir controles como la supervisión humana, los controles de calidad y la monitorización.

- Transferencias internacionales: si los datos salen de la UE, necesitarás garantías legales estándar y una breve evaluación que demuestre que la ruta es segura y está justificada.

La arquitectura defendible

Si estás pensando en integrar la IA en tus aplicaciones de IoT, es fundamental actuar ahora con una arquitectura defendible, que te permita diseñar sistemas y operar sin infringir los estatutos y obligaciones legales o de confianza. Por ejemplo:

- «Edge-first» significa simplemente: filtra y edita todo lo que pueda antes de que los datos se transmitan.

- «Usa tu propia biblioteca» significa almacenar tus documentos y registros en tus propios sistemas con sede en la UE y, a continuación, dejar que la IA busque solo las piezas que necesita para responder a una pregunta.

- «Almacenes aprobados» significa almacenamiento que tu controlas, en la UE, al que solo se puede acceder a través de conexiones privadas, cifrado con tus claves y configurado para eliminarse según un calendario.

- «No entrenar con tus datos por defecto». El sistema de IA que utiliza tus materiales para responder a tus consultas no debe aprender de ellos a menos que tú lo aceptes explícitamente y tenga la base legal para hacerlo.

- La generación aumentada por recuperación (RAG) es un patrón de IA en el que se solicita a un modelo (LLM) un contexto nuevo y específico del dominio, recuperado en tiempo de ejecución de tus almacenes de datos aprobados (documentos, registros, tickets, vectores, tablas). El LLM no «adivina» solo a partir de la memoria, sino que responde utilizando únicamente las pruebas recuperadas que tú le proporcionas.

Basarse en un patrón de generación aumentada por recuperación (RAG) aislado por sesión y centrado en el borde sobre almacenes aprobados le permite cumplir muchas de esas obligaciones.

Las ventajas operativas pueden ser inmediatas y cuantificables.

Por ejemplo, en sectores que van desde la teleasistencia hasta los servicios públicos, las flotas y las infraestructuras críticas nacionales, el mismo patrón (minimizar desde el principio, controlar la recuperación, demostrar la supervisión) se traduce en una gestión más rápida de las incidencias, menos falsos positivos, intervenciones más seguras y menores costes de salida/retención de la nube:

Ventajas en algunos escenarios comunes:

- Atención sanitaria y teleasistencia: la IA puede ayudar a redactar resúmenes y señalar riesgos, pero un médico o un profesional sanitario cualificado debe dar su visto bueno. Los datos sensibles también deben ser censurados de forma temprana, es decir, el audio/vídeo sin procesar se conserva brevemente y luego se elimina; cada alerta significativa tiene un rastro que muestra quién la revisó y por qué.

- Energía y servicios públicos: por ejemplo, la IA se puede utilizar para detectar anomalías y explicarlas en un lenguaje sencillo. En este tipo de entornos, las lecturas detalladas de los contadores se agregan siempre que es posible; la precisión de la ubicación está limitada; y la retención es de meses, no de años.

- Conectividad gestionada (SIM y redes): cualquier análisis de IA debe utilizar seudónimos en lugar de identidades reales; la ubicación exacta de los dispositivos debe difuminarse a menos que sea estrictamente necesario; y los clientes deben poder ver avisos claros sobre lo que se recopila y por qué.

- Recarga de vehículos eléctricos: es imprescindible que las conexiones sean seguras; las sesiones se resumen con fines operativos y de facturación; cualquier vídeo utilizado para reclamaciones se oculta de forma predeterminada y se elimina rápidamente después del caso.

- Telemática de flotas y cámaras de salpicadero: la información de coaching para conductores y gestores de flotas puede contribuir a la seguridad, pero cualquier aspecto que afecte al empleo debe estar sujeto a revisión humana. Los rostros y las matrículas de los vídeos deben difuminarse, salvo que la ley Exige lo contrario.

- CCTV: si el objetivo es la seguridad del sitio, las señales de advertencia deben ser claramente visibles, el acceso a los datos debe ser limitado y cualquier análisis de ocupación debe ser agregado para evitar el seguimiento de personas.

Cinco decisiones de liderazgo que pueden determinar el éxito o el fracaso de los resultados:

- Establece límites claros para los objetivos. Aprueba cada caso de uso con un nombre claro y un alcance definido (por ejemplo, «clasificación de alertas», «redacción de paquetes de reclamaciones»). No firmes «cheques en blanco» como «uso en toda la empresa».

- Controla la ubicación y el acceso a los datos. Exige almacenamiento en la UE, conectividad privada, tus propias claves y calendarios de eliminación. Pide a tu equipo que te muestre pruebas de la implementación.

- Impone la supervisión humana. Define qué decisiones deben ser revisadas por personas antes de actuar. Mide y comunica que esto se lleva a cabo realmente.

- Fija los proveedores y las condiciones. Fija el registro de los proveedores, las regiones, las transferencias, los subprocesadores y tu derecho a realizar auditorías. También es importante establecer por defecto «no impartir formación sobre nuestros datos».

- Crea una «cultura de la evidencia». Convierte en un hábito el solicitar que te «muestren la evidencia» y realiza una auditoría clara: es decir, ¿a qué se accedió, quién lo hizo, para qué y cuándo se eliminó?

Algunos consejos útiles:

- Diseño de la arquitectura: Crea diagramas de una página que muestren dónde se redactan los datos, dónde se almacenan y cómo la IA obtiene el contexto, de modo que haya una comprensión clara e inequívoca.

- Controles de procesos: Comprende claramente aquellas decisiones que requieren la aprobación humana. También es fundamental comprender cuándo y si ese proceso falla, con qué frecuencia y con qué rapidez se corrigen esos errores.

- Datos: Comprende los datos: es decir, ¿Qué conservamos, durante cuánto tiempo y quién puede verlos? Asegúrate de que se mantengan registros de eliminación y se auditen periódicamente.

- Proveedores aprobados: Asegúrate de que se apliquen las ubicaciones de la UE y las conexiones privadas y de que se utilicen tus propias claves. Asegúrate de que los registros de los proveedores se reduzcan al mínimo para proteger los datos.

- Legislación y riesgos: Asegúrate de que las aplicaciones se desglosen en cada caso de uso. Es imprescindible que se comprenda y documente bien la base jurídica de cada caso de uso. También es fundamental comprender en qué casos se recurre a transferencias fuera de la UE y cuáles son las garantías existentes. Cuando los casos de uso se consideren de «alto riesgo» en virtud de la Ley de IA, es imprescindible comprender qué medidas adicionales se aplican en esos casos para cumplir con la Ley de IA y el RGPD.

Métricas e indicadores clave de rendimiento (KPI) que deben revisarse mensualmente:

- Seguridad y precisión: falsas alarmas; eventos perdidos; tiempo de revisión y corrección por parte de personas.

- Higiene de la privacidad: porcentaje de datos eliminados a tiempo; número de excepciones de acceso; frecuencia con la que el sistema recuperó solo lo mínimo necesario para la ejecución.

- Confianza: tiempo para cerrar las solicitudes de acceso/eliminación; recuento de incidentes; cualquier queja y sus tendencias.

- Proveedores: uso de regiones no aprobadas o eventos de registro; y tiempo para bloquear un punto final mal configurado.

Algunas líneas rojas:

Líneas rojas (es decir, no cruzar):

- Es importante garantizar que no se utilice la detección de emociones ni la «adivinación del tipo de persona» a partir de rostros o voces en lugares de trabajo o espacios públicos en los sistemas de IA/IoT.

- Evitar las decisiones exclusivamente automatizadas que produzcan efectos jurídicos o similares (artículo 22 del RGPD). Cuando se recurra a una excepción, aplicar salvaguardias y revisión humana.

- No se deben copiar datos personales sin procesar en conjuntos de entrenamiento de IA sin una nueva revisión legal y avisos actualizados y adecuados.

Un sencillo plan 30-60-90 para comprender la IA en las aplicaciones de IoT

- Primeros 30 días: elige un caso de uso prioritario.

- Define el propósito, los datos y la supervisión.

- Crea la ruta de datos y cómo se utiliza.

- Revisa los contratos de los proveedores en cuanto a región, claves y registro.

- Exige almacenamiento en la UE con conexiones privadas para tus integraciones de IA.

- Establece calendarios de eliminación. Es decir, establece calendarios de eliminación cortos para las indicaciones, los resultados y los registros, y comprueba que funcionan correctamente.

- Activa el desenfoque de rostros/matrículas de forma predeterminada en cualquier vídeo.

- Añade una «hoja de aprobación» de una página que permita y facilita la supervisión humana.

- Días 31-60: Realiza una breve revisión del impacto en la privacidad; añade supervisión para falsas alarmas y eventos perdidos; comienza con métricas mensuales. Forma a los responsables de responder en los nuevos pasos de supervisión.

- Días 61-90: Amplía a los casos de uso segundo y tercero, etc., utilizando el mismo patrón. Publica un breve aviso sobre «cómo utilizamos la IA con los dispositivos» para los clientes y el personal.

Conclusión para los líderes y responsables de la toma de decisiones:

No es necesario aprender los términos técnicos para tomar buenas decisiones a la hora de integrar sistemas de IoT e IA. Sin embargo, es importante comprender los principios clave para implementar con éxito el IoT, que aplique correctamente las normas o aproveche las ventajas de la IA sin infringir la legislación, las normas y los reglamentos de la UE.

Si está interesado en comprender cómo implementar la IA de forma segura y responsable en sus arquitecturas de datos, póngase en contacto con CSL para obtener más información.

Referencias

- [A1] Reglamento (UE) 2024/1689 — Ley de IA de la UE — Texto del Diario Oficial que establece normas armonizadas sobre inteligencia artificial, incluido el artículo 53 (obligaciones de los proveedores de modelos de IA de uso general); establece la supervisión humana y las obligaciones de alto riesgo en el capítulo III. Enlace: https://eur-lex.europa.eu/eli/reg/2024/1689/oj/eng

- [A2] Reglamento (UE) 2016/679 — RGPD — Reglamento general de protección de datos que abarca los principios del tratamiento de datos (art. 5), las bases legales (art. 6) y las categorías especiales de datos personales (art. 9). Enlace: https://eur-lex.europa.eu/legal-content/EN/TXT/?uri=CELEX:32016R0679

- [D1] Decisión de Ejecución (UE) 2023/1795 de la Comisión: Decisión de adecuación del Marco de Protección de Datos (DPF) entre la UE y EE. UU. en virtud del RGPD. Enlace: https://eur-lex.europa.eu/eli/dec_impl/2023/1795/oj

- [E1] Directrices del CEPD 05/2020 sobre el consentimiento: orientaciones del Comité Europeo de Protección de Datos que aclaran cómo obtener y retirar un consentimiento válido en virtud del RGPD. Enlace: https://edpb.europa.eu/our-work-tools/our-documents/guidelines/guidelines-052020-consent-under-regulation-2016679-0_en

- [E2] Directrices del CEPD 07/2020 sobre los conceptos de responsable y encargado del tratamiento: orientación sobre las funciones y responsabilidades de los responsables y encargados del tratamiento en virtud del RGPD. Enlace: https://edpb.europa.eu/our-work-tools/our-documents/guidelines/guidelines-072020-concepts-controller-and-processor-gdpr_en

- [E3] Directrices del CEPD 4/2019 sobre el artículo 25: orientación sobre la protección de datos desde el diseño y por defecto. Enlace: https://edpb.europa.eu/our-work-tools/our-documents/guidelines/guidelines-42019-article-25-data-protection-design-and-default_en

- [E4] Directrices del CEPD n.º 05/2021 sobre el artículo 3 y el capítulo V (transferencias): orientación sobre cuándo el tratamiento constituye una transferencia de datos personales y cómo se aplica el capítulo V. Enlace: https://edpb.europa.eu/our-work-tools/our-documents/guidelines/guidelines-052021-interplay-betweenthe-application-gdpr_en

- [E5] Directiva 2002/58/CE — Directiva sobre privacidad electrónica — Marco actual de la UE que regula los metadatos de comunicaciones y los datos de localización; el Reglamento sobre privacidad electrónica propuesto aún no ha entrado en vigor. Enlace: https://eur-lex.europa.eu/legal-content/EN/TXT/?uri=CELEX:32002L0058

- [J1] TJUE C311/18 («Schrems II»): sentencia del Tribunal de Justicia que establece los requisitos para las evaluaciones de impacto de las transferencias (EIT) y las garantías para las transferencias a terceros países en virtud del RGPD. Enlace: https://eur-lex.europa.eu/legal-content/EN/TXT/?uri=CELEX:62018CJ0311

- [W1] Dictamen 04/2013 (WP205) del GT29 sobre la plantilla de EAI para redes inteligentes y sistemas de medición inteligente: dictamen sobre las expectativas de la EAI para los sistemas energéticos inteligentes. Enlace: https://ec.europa.eu/justice/article-29/documentation/opinion-recommendation/files/2013/wp205_en.pdf

- [W2] Dictamen 12/2011 (WP183) del GT29 sobre medición inteligente: dictamen sobre los riesgos para la privacidad de los datos sobre patrones de consumo y medidas de mitigación. Enlace: https://ec.europa.eu/justice/article-29/documentation/opinion-recommendation/files/2011/wp183_en.pdf

- [W3] Directrices del GT29 sobre la toma de decisiones individuales automatizada y la elaboración de perfiles (WP251 rev.01): orientación sobre las garantías y la interpretación del artículo 22 en relación con las decisiones automatizadas y la elaboración de perfiles. Enlace: https://ec.europa.eu/newsroom/article29/items/612053

Referencias principales para la conectividad y los controles:

- ETSI EN 303 645: requisitos básicos de seguridad para el IoT de consumo: credenciales únicas, actualizaciones seguras, criptografía y gestión de vulnerabilidades. Enlace: https://www.etsi.org/technologies/consumer-iot-security

- Orientaciones de la ENISA sobre el IoT: orientaciones básicas y sobre la cadena de suministro para la seguridad de los dispositivos del IoT. Enlace: https://www.enisa.europa.eu/publications/good-practices-for-security-of-iot

- RFC 8995 (BRSKI): protocolo de incorporación automatizada para la emisión de certificados de dispositivos. Enlace: https://www.rfc-editor.org/rfc/rfc8995

- RFC 7030 (EST): protocolo de inscripción a través de transporte seguro para la gestión de certificados. Enlace: https://www.rfc-editor.org/rfc/rfc7030

- RFC 8520 (MUD): descripción de uso del fabricante para perfiles de red de dispositivos. Enlace: https://www.rfc-editor.org/rfc/rfc8520

- TLS 1.2 / TLS 1.3: especificaciones de seguridad de la capa de transporte. Enlaces: https://www.rfc-editor.org/rfc/rfc5246 (TLS 1.2) y https://www.rfc-editor.org/rfc/rfc8446 (TLS 1.3)

- DTLS 1.2: especificación Datagram TLS. Enlace: https://www.rfc-editor.org/rfc/rfc6347

- OCPP 2.0.1 Security: especificación de seguridad para el protocolo Open Charge Point utilizado en redes de recarga de vehículos eléctricos. Enlace: https://www.openchargealliance.org/protocols/ocpp-201/

- NIS2: Directiva sobre la seguridad de las redes y los sistemas de información. Enlace: https://eur-lex.europa.eu/eli/dir/2022/2555/oj

- Ley de Resiliencia Cibernética (CRA): propuesta para reforzar la ciberseguridad de los productos con elementos digitales. Enlace: https://digital-strategy.ec.europa.eu/en/policies/cyber-resilience-act

- Directiva sobre privacidad electrónica: véase [E5] más arriba.

- SCC: cláusulas contractuales tipo para transferencias transfronterizas de datos. Enlace: https://eur-lex.europa.eu/eli/dec_impl/2021/914/oj

- DPF UE-EE. UU.: Lista de organizaciones estadounidenses certificadas en virtud del Marco de Protección de Datos. Enlace: https://www.dataprivacyframework.gov/s/participants

- Schrems II: véase [J1] más arriba.